-

- ■産学連携

- 国際交流

- ダイバーシティ

- 情報理工学の創造的展開プロジェクト

- 受賞・表彰

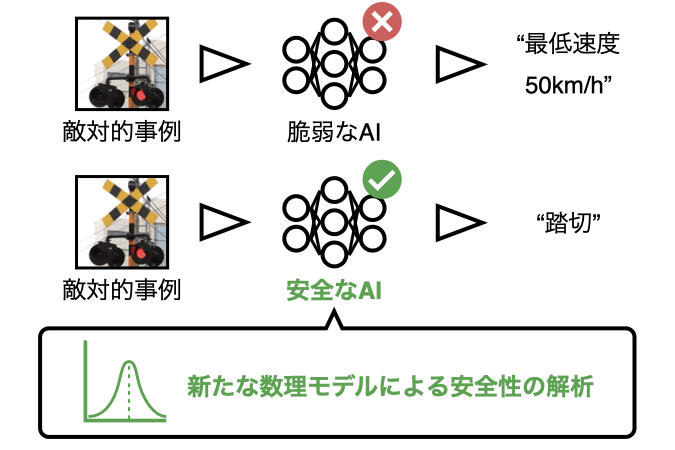

近年、AIは社会に広く浸透しつつあり、時に熟達した人間をも上回る能力を誇ります。しかし、現在のAI技術にはいくつかの課題があり、そのひとつにAIに誤った認識を引き起こさせるように悪意をもって作られる「敵対的事例」があります。この敵対的事例に対しても正しい認識ができるようにAIを訓練することを「敵対的訓練」と呼びますが、敵対的訓練のメカニズムについては理論的な理解がほとんどなされていません。AIの安全性を確かなものにするためも敵対的訓練を理論的に理解し、その効果を数学的に保証することが求められています。

東京大学大学院情報理工学系研究科の熊野創一郎大学院生と山崎俊彦教授を中心とする研究チームは、平均場理論を基にした新たな数理モデルを用いて、敵対的事例からAIを守る防御手法「敵対的訓練」の様々な特性を明らかにしました。

特に興味深い結果として、安全なAIを実現するためにはニューラルネットワークの“幅”構造を広くすることが重要であるという知見を得ました。この特性は多くのニューラルネットワークに対して成り立ち、私たちの解析の幅広い適用可能性を示唆しています。

本研究成果は、2023年12月10日から16日に米国で開催される、機械学習の分野で最も著名な国際会議 Conference on Neural Information Processing Systems (NeurIPS)にて発表されました。

新たな数理モデルによって敵対的訓練を解析することで、より安全なAIの開発を促進

この研究成果についての詳細は【情報理工_プレスリリース_20231204】pdfをご覧下さい。

学会名:Conference on Neural Information Processing Systems, 2023

URL: https://nips.cc/

論文タイトル:Adversarial Training from Mean Field Perspective

著者名:Soichiro Kumano, Hiroshi Kera, and Toshihiko Yamasaki

Copyright © 2019 Graduate School of Information Science and Technology, The University of Tokyo